独立音乐人的 MV 困局

做一支 MV 要花多少钱?说出来都是泪。一支普普通通的 3 分钟 MV,团队、场地、演员、后期加起来,5000 到 2 万美金起步。周期?少说也要两到四周。对于几个月就要发一首新歌的独立音乐人来说,这账根本算不过来。所以大多数人的单曲发布,就只能配一张静态封面图,剩下的全靠缘分。

AI 视频工具说要改变这一切。传张图、写段词,视频就出来了。但现实呢?角色换镜头就换脸,镜头运动僵得像机器人,画面跟音乐节奏完全不搭。生成出来的东西哪是 MV 啊,分明是个带 BGM 的屏保。

Seedance 2.0 来了,专门给 Drama.Land 用户解决这些破事。 这不是又一个看图说话的生成器——它是个多模态引擎,能吃进图片、参考视频、还有你的音乐,然后吐出真正配得上的画面。

现在就去试:Drama.Land

Seedance 2.0 到底强在哪

Drama.Land 一直在做一件事:让 MV 创作变简单。Seedance 2.0 把这事儿往前推了一大步,搞定了之前模型死活解决不了的三个问题:

1. 镜头运动,终于能自己说了算

以前: 你打字"慢慢往左推,带点手持晃动感",然后祈祷模型能 get 到。

现在: 随便找一段你喜欢的 MV,截 5 秒钟传上去。Seedance 2.0 会分析里面的运镜方式——平移、俯仰、跟拍、抖动特征——然后在你的视频里原样复刻。

说人话就是: 不用学什么摄影术语了。看到喜欢的镜头?丢进去当参考,完事。

2. 生成的时候就懂音乐

以前: 先生成视频,再到后期里手动对节拍。画面压根就不是为这首歌设计的。

现在: 把你的歌直接传进去。Seedance 2.0 生成的时候就在听:

- 鼓点落下,画面跟着切

- 人声一进,场景跟着换

- 情绪起伏,动态跟着走

说人话就是: 平台的核心卖点——音乐变视频——这回是真的能用了。画面天生就踩点,不用后期硬掰。

3. 角色不再一镜一个样

以前: 主角换个镜头就换张脸、换个发型、换身衣服。一个"主角"能变出三个人来。

现在: 传 2-3 张不同角度的参考图。Seedance 2.0 生成的时候会交叉比对,保证同一个人在每个镜头里都是同一个人。

说人话就是: 多镜头叙事终于能做了。想做系列?角色能延续。品牌吉祥物?不会跑偏。

多模态到底是什么意思

传统 AI 视频就收一种东西:一张图或者一段文字。镜头怎么动、角色长啥样、节奏怎么踩——全靠它自己猜。

Seedance 2.0 反过来了。你在乎什么,就给什么参考:

| 输入类型 | 数量限制 | 控制什么 |

|---|---|---|

| 图片 | 最多 9 张 | 角色各角度、场景参考、道具 |

| 视频 | 最多 3 段(每段 2-15 秒) | 镜头运动方式 |

| 音频 | 最多 3 段(总共 15 秒) | 节奏、踩点、能量感 |

| 文字 | 不限 | 场景描述 |

一次生成最多塞 12 个文件。想做完整 MV?多生成几次拼起来就行。

这不是为了搞复杂而加功能。每种输入都是为了解决文字描述搞不定的问题。

用户能得到什么

| 能力 | 没有 Seedance 2.0 | 有了 Seedance 2.0 |

|---|---|---|

| 镜头运动 | 文字描述,听天由命 | 参考视频,精准复刻 |

| 角色一致性 | 换镜头就变脸 | 多角度参考,稳得一批 |

| 音乐同步 | 后期手动对 | 生成时就踩点 |

| 输入灵活度 | 1 张图 + 文字 | 9 张图 + 3 段视频 + 3 段音频 |

| 工作流 | 生成 → 剪辑 → 对齐 | 参考 → 生成 → 导出 |

怎么用

第 1 步:备好素材

- 角色照片(2-3 个角度)

- 场景参考图

- 运镜参考视频

- 音频文件(你的歌或者片段)

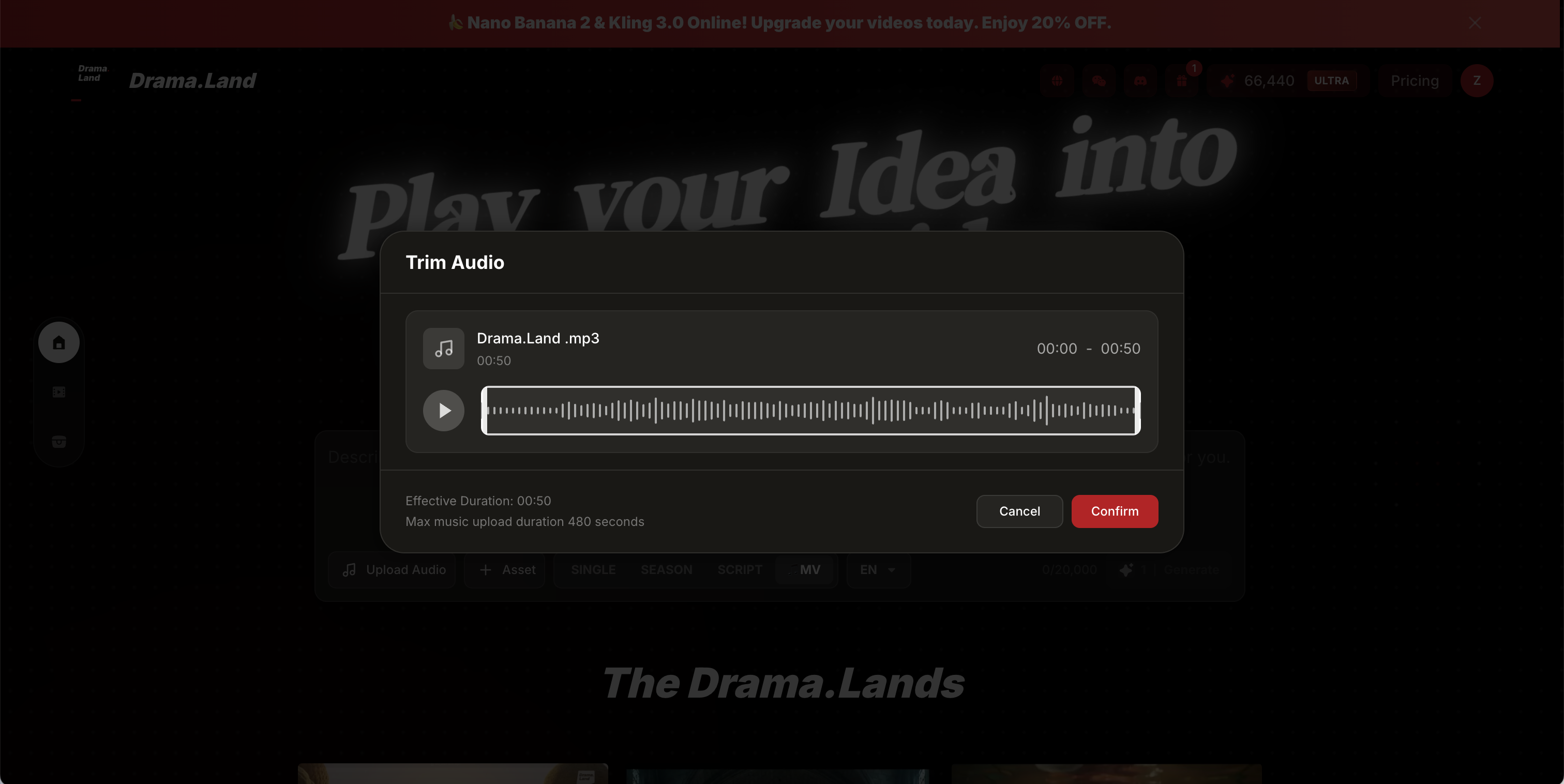

第 2 步:上传 打开 Drama.Land,把素材拖进去。

第 3 步:写描述 写这个镜头里发生什么事。不用描述镜头怎么动、角色长啥样——参考素材会搞定。

第 4 步:生成、检查 生成片段,拼成完整 MV。满意就继续做,不满意就换参考素材再来。

第 5 步:导出 加上自动生成的音效,或者用你自己的原曲。