AI 音乐的老毛病

你肯定遇到过。输入歌词,选个风格,点生成。出来的东西听着……好像还行。直到节拍在长段落里乱了套。直到歌曲在半句话的地方突然断掉。直到人声被乐器淹没得听不清。

AI 音乐有个一致性问题。副歌不错,过门崩了。主歌挺好,结尾突然没了。纯器乐呢?大多数模型压根不当回事。

MiniMax Music 2.5+ 把这些都修了。现在已经上线 Drama.Land。

MiniMax Music 2.5+ 给 Drama.Land 带来了什么

说唱和嘻哈,终于有律动了

长段落一直是 AI 音乐的噩梦。你写了 16 小节的说唱,到第 9 小节左右,节拍开始跑偏。词堆在一起。节奏变得干巴巴。跟你脑子里想的完全不是一回事。

Music 2.5+ 能搞定这个。模型会紧跟你的歌词。它知道哪个词该重读,哪里该换气,哪里该踩点。不是一行一行地跟,而是一整段一整段地跟。你写了快节奏、密押韵的段落,节拍跟得上。你放慢下来唱个旋律性的 hook,音乐也跟着转。

对 Drama.Land 上做 MV 的人来说,这很重要。你可能在给一个场景配诗朗诵,或者给蒙太奇做一段嘻哈。不用再重新生成五遍祈祷节奏能对上。第一次就能锁住律动。

给一点就能出完整歌曲

AI 音乐工具有个常见问题。你给它一个简短的提示,可能就一段副歌的想法。它给你吐出半首歌。没有前奏。主歌从半截开始。结尾直接……没了。这种"无头歌曲"听起来像有人从中间开始录,然后忘了剪辑。

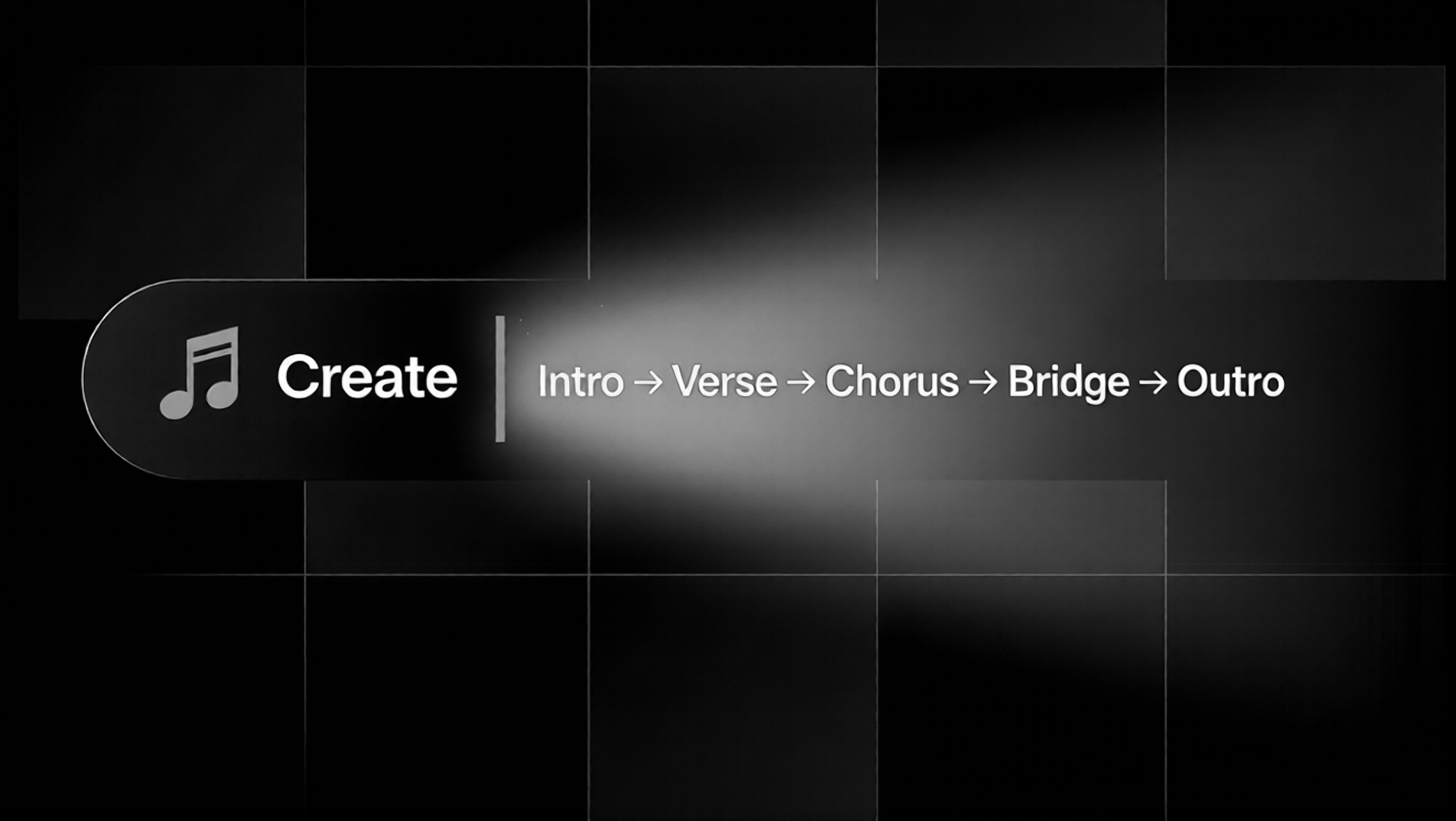

Music 2.5+ 理解完整的歌曲结构。给它一段副歌,它会围绕着搭建出来。一个定调的前奏。展开主题的主歌。制造张力的桥段。收尾的尾奏。模型会补全缺失的部分。你不用把每个段落都写出来。

对 Drama.Land 用户来说,这意味着更快的工作流。描述一个氛围,丢进一个 hook,拿到一首完整的歌。不用再把碎片拼接在一起。不用再给结束太早的歌强行淡出。一个提示,一首完整的歌。

专业级器乐音乐

大多数 AI 音乐模型只关注带人声的歌。你要纯器乐,它给你的是把人声去掉的版本。听得出来。混音感觉空洞。编曲缺乏层次。听起来像卡拉 OK 伴奏。

Music 2.5+ 把器乐当主力功能来做。模型用了超过 100 种乐器。原声吉他。管弦乐弦乐。电子合成器。世界打击乐。它做出来的编曲本身就是完整的。有层次,有递进,有不需要人声的 hook。

混音也很聪明。要摇滚,就给你失真和冲击力。要电影感,就给你深度和空间感。Lofi 就给你温暖的压缩和黑胶质感。出来的东西听起来就是为那个风格做的,不是过了一遍通用流水线。

这给 Drama.Land 打开了新的使用场景。游戏开发者可以直接做原声带。电影人可以给场景配乐,不用担心版权。品牌可以做定制音频。YouTuber 可以做契合内容的背景音乐。全都不用碰 DAW,不用请作曲。

不用后期处理,混音就是干净的

AI 音乐经常听起来"糊"。人声和乐器抢地盘。所有东西都被压成一堵噪音墙。单独听还行。但加上对白或音效,就成了一团糟。

Music 2.5+ 一开始就给你干净的分离。人声有自己的空间。乐器清晰分明。低音不会淹掉中频。高音不会刺耳。

好处是不用花时间修问题。当你把音轨导入 Drama.Land,它已经是平衡的了。你可以把它放在对白下面,不会打架。你可以加音效,不用找空隙。音乐作为制作元素直接能用,不是个需要你去清理的粗糙 demo。

在 Drama.Land 上怎么用

-

选择 MV 模式。 描述你的构想,添加素材,点生成。

-

用 Music 2.5+ 生成音乐。 得到一首结构完整、混音干净、节奏紧凑的完整曲目。

-

制作视频。 Drama.Land 会把画面同步到你的音轨。嘴型对上歌词。动作踩上节拍。镜头切换跟着音乐走。

-

导出。 一支完整的、可以发布的 MV。

开始使用

MiniMax Music 2.5+ 已在 Drama.Land 正式上线。